Προειδοποίηση | Σύντομα τα fake news θα κρίνουν εκλογές

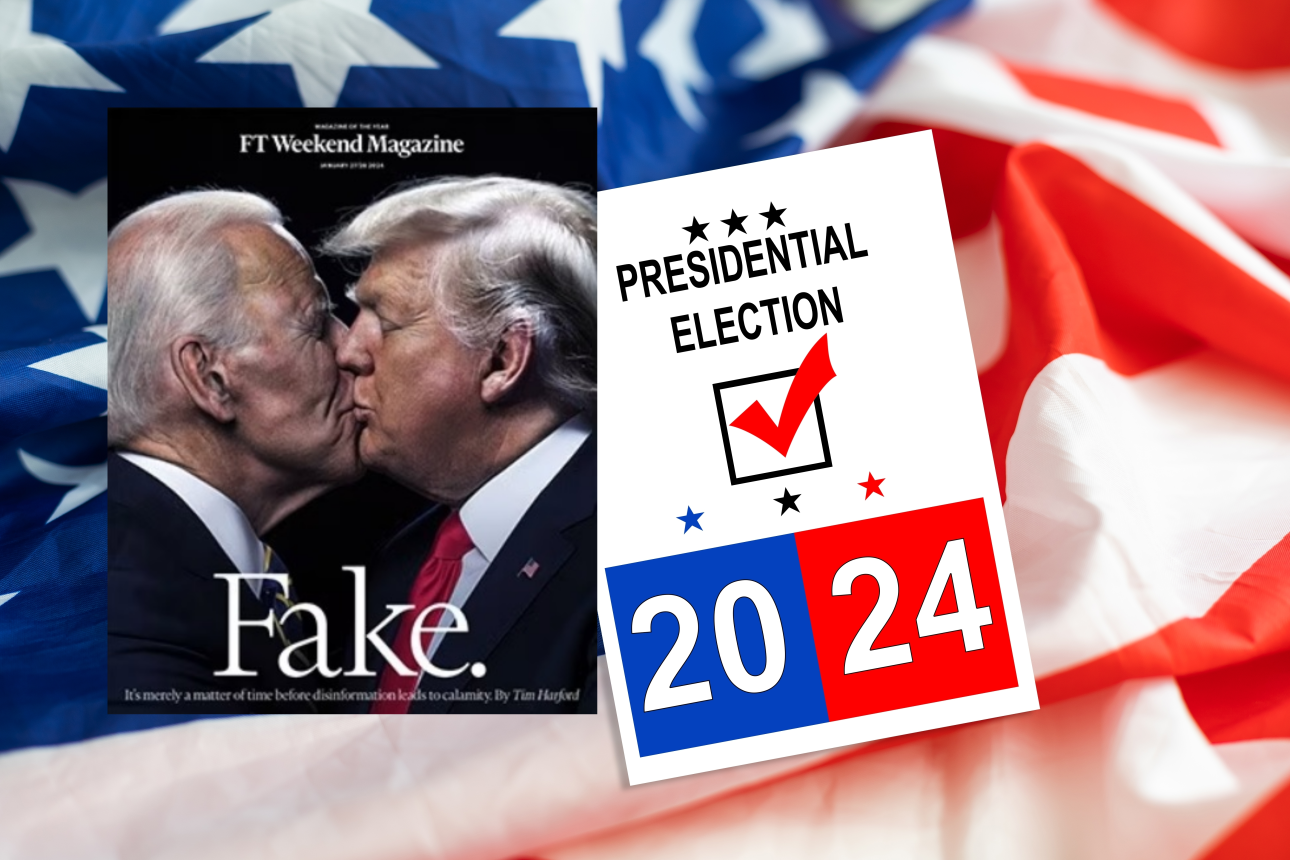

Οι ανησυχίες για τις επιπτώσεις της «μετα-αλήθειας», που έγινε λέξη της χρονιάς το 2016 όταν εξελέγη ο Τραμπ, εντείνονται όσο προοδεύει η Τεχνητή Νοημοσύνη – Tο 2024 θα έχουμε τις περισσότερες εκλογικές αναμετρήσεις στην Iστορία – Οι ειδικοί λένε στους FT ότι είναι θέμα χρόνου ένα ψέμα να καθορίσει το αποτέλεσμα της κάλπης

Το 2016, τη χρονιά που ο Τραμπ εξελέγη πρόεδρος των ΗΠΑ λέγοντας πως θα έχτιζε έναν «όμορφο τοίχο» στα σύνορα με το Μεξικό, τον οποίο μάλιστα θα πλήρωναν οι Μεξικανοί, το λεξικό της Οξφόρδης (Oxford Dictionaries) ανακήρυξε την «μετα-αλήθεια» λέξη της χρονιάς. Η λέξη περιέγραφε με τον πλέον επίκαιρο τρόπο την πολιτική ρητορική (και συνάμα πρακτική) που αγνοεί την αλήθεια και βασίζεται σε μια προσωπική, ενίοτε εντελώς πλαστή, εκδοχή της πραγματικότητας.

Ηταν μια εποχή προβληματισμού για το γεγονός ότι οι άνθρωποι ανακαλύπτουν νέους τρόπους για να μας λένε ψέματα. Το 2016, τα λεγόμενα deepfakes (η τεχνική δημιουργίας και δημοσίευσης ψευδών πληροφοριών με τη μορφή βίντεο, ήχου και φωτογραφιών) ήταν προφανή, σε βαθμό που λειτουργούσαν καθησυχαστικά για τις ανησυχίες. Οκτώ χρόνια μετά, η αλματώδης πρόοδος της Τεχνητής Νοημοσύνης (AI) οδηγεί στην αντίθετη κατεύθυνση: οδηγεί αυτές τις ανησυχίες ένα βήμα παρακάτω.

Σε αναλυτικό τους δημοσίευμα, οι Financial Times τονίζουν ότι «η δημιουργία deepfakes είναι δύσκολη —υπάρχουν ευκολότεροι τρόποι να πει κανείς ψέματα με βίντεο. Θα μπορούσατε, για παράδειγμα, να περιγράψετε με λάθος τρόπο ένα υπαρκτό βίντεο. Τον Δεκέμβριο του 2023, κυκλοφόρησαν βίντεο στα μέσα κοινωνικής δικτύωσης που ισχυρίζονταν πως έδειχναν τη Χαμάς να εκτελεί ανθρώπους πετώντας τους από την οροφή ενός κτιρίου στη Γάζα. Τα βίντεο ήταν γνήσια, αλλά η θηριωδία έλαβε χώρα στο Ιράκ το 2015 και οι δολοφόνοι ήταν το Ισλαμικό Κράτος, όχι η Χαμάς».

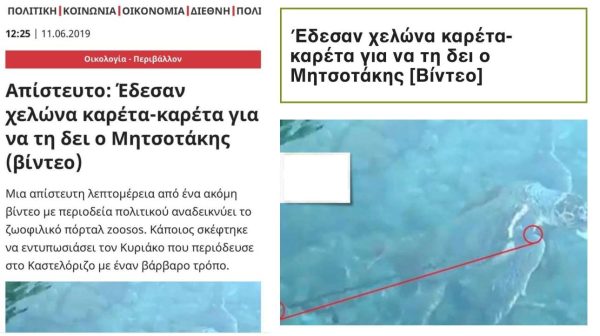

Είναι σύνηθες φαινόμενο και στην Ελλάδα να διακινούνται στο διαδίκτυο αληθινά βίντεο και φωτογραφίες που αφορούν στο παρελθόν και άλλες περιστάσεις/συμφραζόμενα από αυτές που περιγράφουν όσοι τα χρησιμοποιούν για να πετύχουν τους σκοπούς τους.

Ακόμη και απλά τεχνάσματα, συνεχίζει η εφημερίδα, επιτυγχάνουν σχεδόν το ίδιο αποτέλεσμα. «Ας πούμε ότι βρισκόμαστε στις εκλογές του 2016 και θέλετε να δημιουργήσετε ένα αστείο βίντεο με τον (διάσημο ηθοποιό και παλαιστή) Ντουέιν Τζόνσον να τραγουδάει ένα υβριστικό τραγούδι στην υποψήφια πρόεδρο Χίλαρι Κλίντον που να περιλαμβάνει και την αντίδρασή της σε αυτό. Οχι κάτι σπουδαίο, απλά για να γελάσετε. Είναι εύκολο: Βάζουμε πλάνα με τον Τζόνσον να τραγουδάει ένα υβριστικό τραγούδι για έναν άλλο παλαιστή. Προσθέστε πλάνα με τη Χίλαρι Κλίντον να δείχνει λίγο αμήχανη. Ενώστε τα -όπως έκανε ένα τρολ- και έχετε μια χοντροκομμένη φάρσα που απεικονίζει ένα γεγονός της προεκλογικής εκστρατείας που δεν συνέβη ποτέ».

Το βίντεο με το παραπλανητικό μοντάζ εμφανίζει τον διάσημο αμερικανό ηθοποιό, τραγουδιστή και επαγγελματία παλαιστή, Ντουέιν Τζόνσον, να απευθύνει δήθεν ένα υβριστικό τραγούδι στη Χίλαρι Κλίντον. Κάποιοι το πέρασαν για αληθινό γεγονός (YouTube/@paulateale4994) :

Στο βιβλίο του με τίτλο «Μην Εμπιστεύεστε Κανέναν: Μέσα στον Κόσμο των Deepfakes» (Trust No One: Inside the World of Deepfakes) ο δημοσιογράφος Μάικλ Γκρότχαους πήρε συνέντευξη από το τρολ που δημιούργησε και διακίνησε το παραπάνω, εμφανώς χοντροκομμένο, βίντεο.

Ο άνθρωπος που χειριζόταν τον τρολ λογαριασμό στα social media συνειδητοποίησε κάτι ανησυχητικό. Το βίντεο που είχε φτιάξει γινόταν viral στο Facebook και τα σχόλια έπεφταν βροχή: πολύς κόσμος το πίστευε. «Περίμενε», είπε το τρολ στον Γκρότχαους. «Αυτά τα ηλίθια σκ….@ νομίζουν ότι αυτό είναι αληθινό;», διερωτήθηκε σύμφωνα με τους FT.

Και όμως, παρότι ήταν κακοφτιαγμένο και ξεκάθαρα fake (καμία σχέση με την Τεχνητή Νοημοσύνη και την τεχνική των deepfake) πολλοί το πίστεψαν. Στην Ελλάδα, στις εθνικές εκλογές του 2019, σειρά λογαριασμών των social media και ενημερωτικών ιστοσελίδων παρουσίαζαν βίντεο και φωτογραφίες μαζί με μια ψεύτικη είδηση ότι δήθεν οι κάτοικοι του ακριτικού Καστελόριζου «έδεσαν μια θαλάσσια χελώνα για να τη δει ο Μητσοτάκης», τότε αρχηγός της αξιωματικής αντιπολίτευσης. Επρόκειτο για ένα ξεκάθαρο fake news, καθώς από το βίντεο ήταν εμφανές πως η χελώνα δεν ήταν δεμένη με σχοινί, αλλά μπλέχτηκε για μικρό χρονικό διάστημα σε σχοινί βάρκας (περισσότερα εδώ).

Η ψεύτικη είδηση αναδημοσιεύθηκε σε πολλά ΜΜΕ στην κορύφωση της προεκλογικής εκστρατείας του 2019:

Με δεδομένο ότι το 2024 θα είναι η χρονιά με τις περισσότερες εκλογικές αναμετρήσεις στην Iστορία (έχουμε κάλπες σε 76 χώρες), o αρθρογράφος της εφημερίδας Τιμ Χάρφορντ ρώτησε τους ειδικούς.

Οι περισσότεροι του μετέφεραν την ανησυχία τους «ότι είναι θέμα χρόνου μια έξυπνη, καλά συγχρονισμένη παραπληροφόρηση να έχει ολέθριο αντίκτυπο, κρίνοντας το αποτέλεσμα μιας εκλογικής αναμέτρησης. Μπορεί να μην αφορά ένα deepfake ή μια άλλη οπτική εικόνα που δημιουργείται από Τεχνητή Νοημοσύνη. Από την άλλη, μπορεί να συμβεί και με αυτό τον τρόπο. Η τεχνολογία βελτιώνεται: είναι ήδη απλό να δημιουργηθεί ένα πειστικό deepfake, ή να χρησιμοποιηθεί Τεχνητή Νοημοσύνη για την κατασκευή μιας φωτορεαλιστικής σκηνής που δεν συνέβη ποτέ. Είναι ελάχιστα πιο δύσκολο από την επεξεργασία ενός υπάρχοντος βίντεο».

Ενα παράδειγμα ηχητικού deepfake είναι αυτό που συνέβη πριν από λίγες μέρες στις ΗΠΑ. Στις προκριματικές εκλογές του Νιου Χάμσαϊρ για τους Δημοκρατικούς (23/1), πολίτες της περιοχής που ανήκουν στο Δημοκρατικό Κόμμα έλαβαν ένα ρομποτικό τηλεφώνημα στο οποίο άκουγαν μια φωνή που αντέγραφε πιστά μέσω Τεχνητής Νοημοσύνης αυτή του προέδρου Τζο Μπάιντεν και τους καλούσε να μην ψηφίσουν.

Προηγουμένως, το επιτελείο του Μπάιντεν είχε έρθει σε ρήξη με το επιτελείο των Δημοκρατικών της περιοχής και στο ψηφοδέλτιο δεν υπήρχε το όνομα του προέδρου. Το τοπικό επιτελείο του Μπάιντεν δεν ζητούσε από τους ψηφοφόρους την αποχή αλλά να συμπληρώνουν χειρόγραφα το όνομα του Μπάιντεν στο ψηφοδέλτιο, κάτι που συνέβη, και ο Μπάιντεν κέρδισε (περισσότερα εδώ από τον Guardian).

Σύμφωνα με το NBC Νews, το γραφείο του γενικού εισαγγελέα του Νιου Χάμσαϊρ ερευνά την προσπάθεια επηρεασμού των ψηφοφόρων μέσω του ρομποτικού τηλεφωνήματος. Διότι αυτός που το έκανε, προφανώς ήθελε λιγότερες ψήφους για το ίδιο τον Μπάιντεν.

Ακούστε τη ψεύτικη -αλλά πολύ πειστική- φωνή που μιμείται αυτή του Τζο Μπάιντεν στο συμβάν του Νιου Χάμσαϊρ (X/ NYPost/ NBC News/ @tsarnick):

H άλλη όψη

Περάσαμε λοιπόν ήδη από την παραπλανητική χρήση εικόνων και βίντεο, όπως το τραγούδι του Ντουέιν Τζόνσον και η χελώνα του Καστελόριζου, στο επόμενο στάδιο: στην deepfake εικόνα και στον deepfake ήχο. Ορισμένοι ειδικοί θεωρούν ότι σταδιακά το κοινό θα το συνηθίζει κι αυτό και θα μάθει να αμφισβητεί τη γνησιότητα όσων βλέπει και ακούει στα social media.

Μήπως και αυτή η οδός, της δυσπιστίας στα όρια του κυνισμού, κρύβει κινδύνους; «Ποιο είναι το βαθύτερο πρόβλημα, οι άνθρωποι που πιστεύουν κακόβουλες ανοησίες ή οι άνθρωποι που αρνούνται να πιστέψουν την προσεκτικά τεκμηριωμένη δημοσιογραφία; Δεν είμαι σίγουρος. Αλλά είναι σίγουρα πιθανό ότι ο καθολικός κυνισμός είναι μια θεραπεία που είναι χειρότερη από την ασθένεια» υπογραμμίζει ο Τιμ Χάρφορντ στους Financial Times.

«Τα deepfakes, όπως και όλα τα fakes, αυξάνουν την πιθανότητα οι άνθρωποι να μπερδέψουν ένα ψέμα με την αλήθεια, αλλά δημιουργούν επίσης χώρο για να μπερδέψουμε την αλήθεια με το ψέμα», προσθέτει. Και αναρωτιέται πόσο σύντομα οι πολιτικοί θα μπορούν να αποτινάξουν από πάνω τους αποδεικτικά στοιχεία σε ένα βίντεο για τη δική τους, κακή συμπεριφορά, ισχυριζόμενοι ψευδώς ότι το ίδιο το βίντεο είναι ψεύτικο.